アマゾンのスマートグラス、一般発売しない理由…物流を支配する新UI戦略

●この記事のポイント

・アマゾンは配達員向けにスマートグラスを導入し、物流現場でのAI支援とデータ収集を強化する。

・海外ではAI時代の新UIとして開発競争が活発化する一方、日本では制度・文化・投資面で停滞。

・“監視か共進化か”——スマートグラスは労働の在り方と人間の拡張を問い直すテクノロジーとなる。

アマゾンが米国内で一部の配達員に向け来春、スマートグラスを本格導入すると発表した。現在、最終テスト段階にあるという。

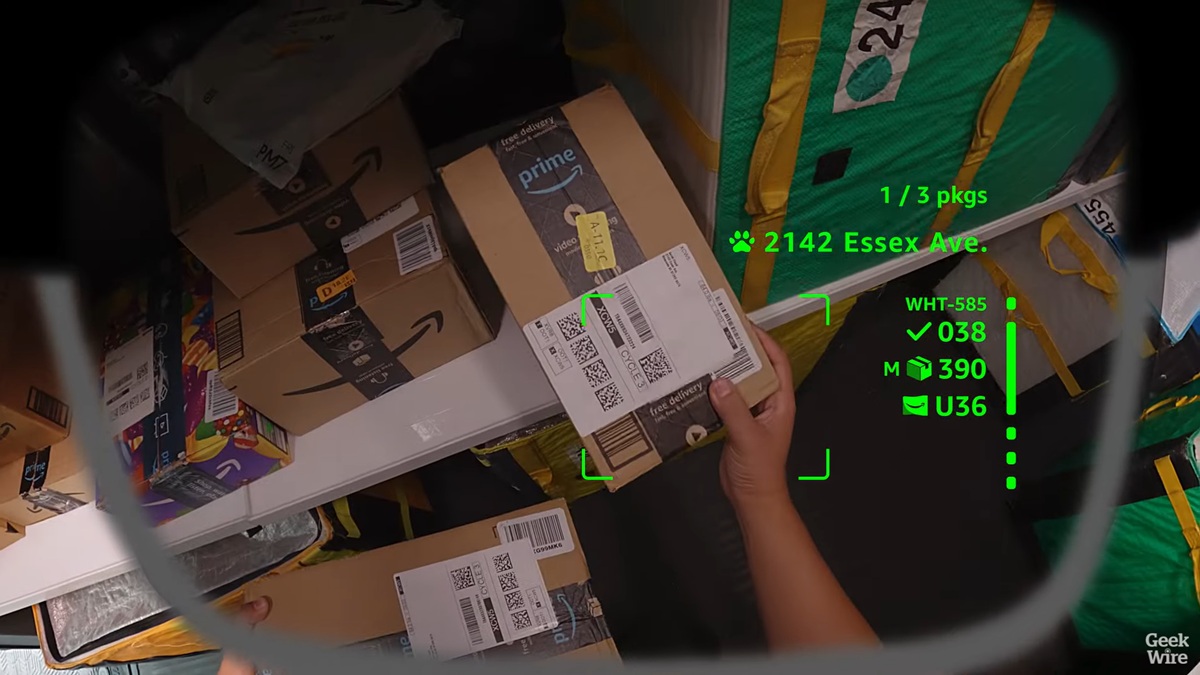

「どの荷物を、どの順番で、どの玄関先に届けるか」。これまで手持ちの端末で確認していた情報が、グラスのディスプレイに重ねて表示される。AIがリアルタイムでルートを最適化し、誤配や迷いを減らす。両手が空くことで作業効率が上がり、雨天や夜間でもスムーズに配達が行えるという。

導入されるのは、アマゾンが自社開発した業務専用のスマートグラス。一般販売を前提としていない点が、XREAL(エクスリアル)、Meta(メタ、旧フェイスブック)、Huawei(ファーウェイ)、Lenovo(レノボ)などが展開する“汎用型”デバイスとは異なる点だ。

専門家は、アマゾンの目的は「未来の物流を実現するためのUI(ユーザーインターフェース)再設計」にあると分析する。

●目次

なぜ「一般向け」ではなく「配達員向け」なのか

「アマゾンはこれまでも、Echo Framesなどの一般向けスマートグラスを試作・販売してきましたが、商業的には成功していません。同社が今回、消費者ではなく現場労働者=物流従業員にターゲットを絞ったのは、ユースケースが明確でROI(投資対効果)が測定しやすいためです。物流現場では、秒単位の効率化が売上・顧客満足に直結します」(ITジャーナリスト・小平貴裕氏)

すでにアマゾンの倉庫ではピッキング作業にARを用いた支援が導入されており、今回のグラスはその延長線上にある。つまり、同社は“人間の視界そのものをデータ化する”という方向に舵を切ったのだ。

グラスを通して配達員の視線や動作データを収集することで、AIが学習し、より最適化された動線やレイアウト設計が可能になる。単なる便利ガジェットではなく、人間×AIによる共同作業の実験場として位置づけられている。

メタは「Ray-Ban Meta」を、エクスリアルは軽量ARグラス「Air 2 Pro」を、ファーウェイやLenovoも独自モデルを展開。アメリカや中国ではいま、スマートグラスを“次世代コンピューティングデバイス”と位置づけ、開発投資が再び加速している。

背景には大きく三つの潮流がある。

1.AIエージェント時代の新UI探し

ChatGPT、GeminiなどのAIエージェントが普及する中、スマホ画面を介さずに自然にAIと対話する新たなハードウェアが求められている。

音声、視線、ジェスチャーといった人間の“非言語操作”を起点に、AIが行動を補助するデバイス——その最有力候補がスマートグラスだ。

2.物流・医療・製造など現場業務のDX化

現場作業者にとって、両手が使えるウェアラブルは圧倒的な利便性をもつ。

マニュアル確認、映像共有、リアルタイム支援など、現場業務の効率化に直結するユースケースが多い。

3.Apple Vision Proが開いた“XR再評価”の波

高価ながらも市場の注目を集めたVision Proは、視覚インターフェースの可能性を再認識させた。

各社はより軽量で日常的に装着可能な形態——つまり「グラス型」へと向かっている。

日本ではなぜ話題にならないのか

「日本では、2010年代前半にGoogle Glassが登場した際の“失敗の記憶”が根強くあります。『プライバシー侵害』『目立って恥ずかしい』『使い道がない』といった印象が社会的に残り、再ブームを阻んでいると考えられます」(同)

さらに、構造的な課題もある。

1.顔認識・録画などに対する法制度の未整備

欧米ではGDPRなどの規制のもとで限定的利用が許容されるが、日本では法的グレーゾーンが多い。

企業が本格的に導入しづらい環境にある。

2.作業現場のDX投資の遅れ

物流や建設といった現場労働の分野で、まだタブレット端末が中心。

「次世代インターフェース」としての導入まで踏み込めていない。

3.消費者向けガジェットへの慎重姿勢

メガネ文化が強い一方で、“デジタル化したメガネ”に対する心理的ハードルが高い。

「常時カメラがついている」ことへの抵抗感も根強い。

結果、日本ではXRがエンタメ・展示領域にとどまり、日常や労働現場に根づくインフラとしては浸透していない。

アマゾンの戦略の本質:「物流UIの再発明」

今回のスマートグラス導入は、「配送員をAIで置き換える」のではなく、配送員がAIと共に働く新しい形をつくる試みだ。

グラスにはカメラ・GPS・マイク・ディスプレイが搭載され、AIが視覚情報を解析して「誤配送を警告」「荷物の置き場所を指示」「顧客からのリアルタイム要望を表示」などを行う。音声とARが組み合わさった“半自動運転的”な体験であり、人間をハードウェアの一部として再定義するような構造だ。

この仕組みは、アマゾンが進めるAI物流ネットワーク構想と連動している。倉庫・ルート・車両・人をすべてデジタルツイン上で統合し、リアルタイムで最適化する「見える物流(Visible Logistics)」の中核デバイスとなる。

小平氏は、「アマゾンの動きは、今後のスマートグラス市場全体にも波及する」とみる。

すでに次のような分野での導入が視野に入っている。

1.医療現場

手術中の医師が、患者データやCT画像を視界に重ねて確認。

遠隔地の専門医が映像共有しながら支援するシステムが現実に。

2.製造・保守点検

熟練技術者の作業を新米がAR越しに学習。

遠隔からの支援・教育コストを削減。

3.小売・接客

店員の視界に顧客の過去購買履歴や在庫情報を表示し、パーソナライズされた接客を実現。

4.教育・トレーニング

実際の現場映像に仮想情報を重ねることで、没入型の職業訓練が可能に。

5.観光・エンタメ

ARナビやリアルタイム字幕翻訳によって、言語や地理の壁を超える体験を提供。

このように、スマートグラスは「作業効率化ツール」から「拡張知覚デバイス」へと進化しつつある。AIエージェントが常にユーザーの“視界内”で働く未来——その最初の商用実験場が物流現場なのだ。

スマートグラスが描く「ポストスマホ時代」

注目すべきは、テクノロジー倫理と労働の境界線である。配達員の動作データや視線情報がクラウドに収集されることで、効率化と同時に「監視強化」への懸念も高まる。AIが“見ている”職場は、果たして働きやすいのか。

一方で、現場労働者がテクノロジーを活用し、熟練をAIに“転写”していくことで、ノウハウの継承や業務標準化が進むというポジティブな側面もある。

この“監視と共進化の境界”をどうデザインするかが、今後の最大のテーマとなる。

スマホが人間の「手の延長」だったのに対し、スマートグラスは「目と脳の延長」となる。情報は検索するものではなく、視界に自然に現れるものへ——。アマゾンのスマートグラスは、その転換点を象徴する。同社が消費者ではなく労働者に導入したのは、“未来の生活”ではなく“未来の仕事”をまず作り変える意図の表れだ。

物流の次は、医療・建設・教育。そして、やがて私たちの生活へ。AIが目の前に“見える”世界は、もうすぐそこにある。

(文=BUSINESS JOURNAL編集部)

(GeekWire / YouTube)