「ChatGPT脆弱性」報道の深層…DNSトンネリングによる情報漏洩リスクと設計課題

●この記事のポイント

ChatGPTにおいてDNS問い合わせを悪用したデータ流出経路(DNSトンネリング)の存在がCheck Point社により指摘された。この問題は、従来の脆弱性とは異なり、LLMが外部と連携する際の設計上の課題を示している。OpenAIはすでに修正済みだが、AIエージェント化によるリスク拡大を見据え、企業は通信監視などの「振る舞い」に対するセキュリティ対策が求められる。

「ChatGPTに脆弱性が発覚。機密情報が外部に漏洩する恐れ」――。2026年3月末、セキュリティ大手チェック・ポイント・ソフトウェア・テクノロジーズ(以下、チェック・ポイント社)が発表した調査結果は、瞬く間に世界中のIT担当者の間に波紋を広げた。

しかし、この報道を「従来のウイルス感染やハッキングと同じ」と捉えるのは早計だ。本件の本質は、システムの不具合というよりも、大規模言語モデル(LLM)という新しい技術が抱える「設計上の境界線」の難しさにある。

本稿では、この「DNSを利用した外部通信」の仕組みを解剖し、ビジネスリーダーが直面している真のリスクと、冷静な対処法を浮き彫りにする。

●目次

- 何が起きたのか? 「DNSトンネリング」という隠れ家

- 過大評価すべきでない理由:システム崩壊ではない

- 過小評価すべきでない理由:LLM時代の「新しい攻撃面」

- 問われるのは企業の「ガバナンス」

- 煽られず、しかし「設計の転換」を

何が起きたのか? 「DNSトンネリング」という隠れ家

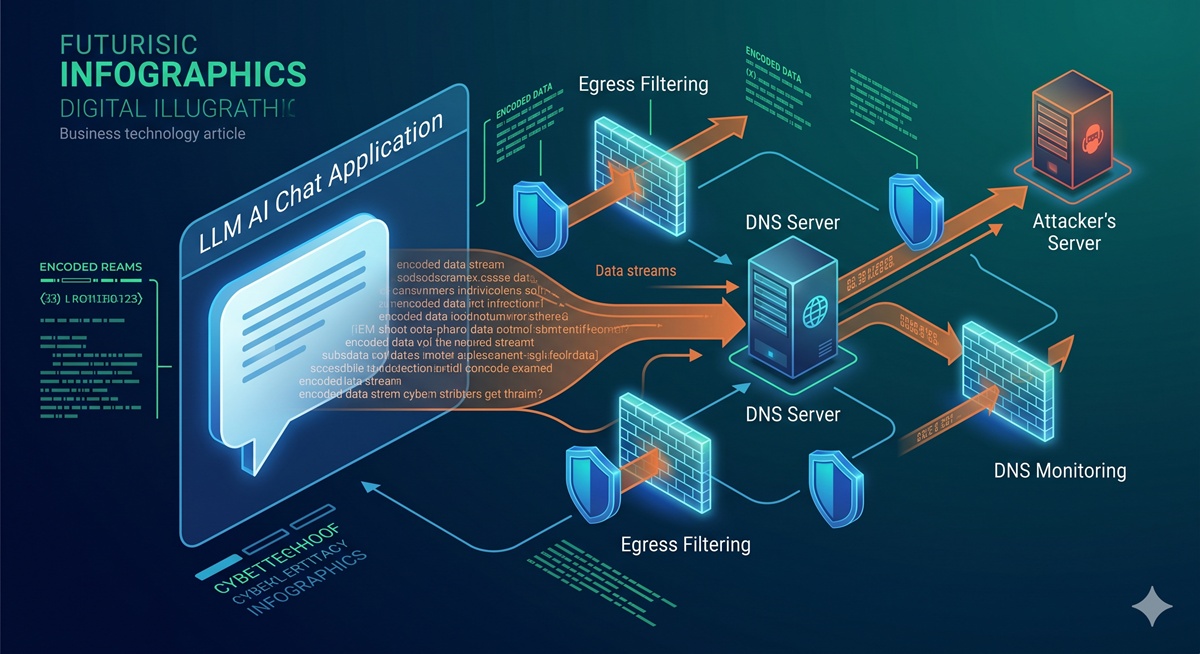

今回の指摘は、ChatGPTの「コード実行(Advanced Data Analysisなど)」機能のランタイム環境において、本来遮断されているはずの外部通信が、DNS(ドメイン名システム)という「インターネットの電話帳」の仕組みを悪用することで成立してしまった、というものだ。

通常、ChatGPTの内部環境はインターネットから隔離(サンドボックス化)されている。しかし、ホスト名からIPアドレスを割り出すDNSの問い合わせだけは、システム運用上、許可されている場合が多い。攻撃者はこの「隙間」を突いた。

【手口のステップ】

悪意あるプロンプト:ユーザーに「便利なツール」と偽った指示を入力させる、あるいは外部のWebサイトを読み込ませる(間接的プロンプト注入)。

データの符号化:ChatGPT内部で動作するコードが、流出させたい機密データ(例:アップロードされたPDFの内容)を、data.attacker.comのようなドメイン名の一部に埋め込む。

DNSクエリ:システムがそのドメインを解決しようとした瞬間、攻撃者の管理するネームサーバーに、データが含まれたリクエストが到達する。

チェック・ポイント社の実証によれば、この手法により、ユーザーが意図しない形でプロンプトや機密ファイルの内容が外部へ「無断で」送信されるリスクがあった。

過大評価すべきでない理由:システム崩壊ではない

報道の見出しだけを見ると、ChatGPTを使えば即座に情報が盗まれるかのような印象を受けるが、現実的なリスクの度合いは限定的だ。

「脆弱性」という言葉の定義: OSのバグやネットワークの突破といった従来の脆弱性(CVE)とは性質が異なる。あくまで「アプリケーションが許可された機能の範囲内で、意図しない振る舞いをした」にすぎない。

すでに修正済み:OpenAIは本件を重く受け止め、2026年2月20日の時点で修正(パッチ)の展開を完了している。現在、正規のChatGPT環境で同様の手法を再現することは困難だ。

高い実行ハードル:この攻撃を成立させるには、ユーザーが「非常に巧妙に細工されたプロンプト」を自ら入力するか、悪意ある外部プラグインやGPTsを自ら選択して使用する必要がある。

「今回の件を『ChatGPTがハッキングされた』と報じるのは誤解を招きます。正確には、AIに計算をさせるための『隔離部屋』に小さな換気口が開いており、そこから小さな紙飛行機を飛ばせることを証明した、というレベルです。一般のユーザーが普通に会話を楽しんでいる分には、心配しすぎる必要はありません」(サイバーセキュリティコンサルタントの新實傑氏)

過小評価すべきでない理由:LLM時代の「新しい攻撃面」

一方で、このニュースを「単なるマイナーなバグ」として片付けるのも危険だ。なぜなら、今回の事象は「AIが外部システムと連携する際のセキュリティ境界」が極めて脆弱であることを露呈させたからだ。

(1)「非コード」による情報漏洩の現実味

従来のセキュリティ製品は、実行ファイルや通信パケットを監視してきた。しかし、LLMでは「自然言語」そのものが命令(コード)として機能する。今回のケースは、コードが介在せずとも「出力結果」そのものが攻撃ベクトル(経路)になり得ることを示唆している。

(2)AIエージェント化によるリスク増大

2026年現在、AIは単なるチャットボットから、自律的にブラウジングし、APIを叩き、メールを送る「エージェント」へと進化している。

Excessive Agency(過剰な権限):AIがユーザーに代わってアクションを起こす際、今回のような「隠れ通信路」が組み合わさると、ユーザーの気づかないところで企業の内部情報が外部のAPIへ流出し続けるリスクが現実のものとなる。

(3)セキュリティ標準の更新(OWASP LLM 2025)

Webセキュリティの世界的基準であるOWASPが発表した「Top 10 for LLM Applications 2025」では、「LLM02: Sensitive Information Disclosure(機密情報の開示)」や「LLM06: Excessive Agency(過剰な権限)」が上位にランクインしている。今回のDNS経由の流出は、まさにこのトレンドを裏付ける実例といえる。

問われるのは企業の「ガバナンス」

サイバーセキュリティの専門家は、今回の騒動をどう見ているのか。

「本質的な問題は、AIモデルそのものの欠陥ではなく、AIを取り巻く『エコシステム』の設計にあります。多くの企業がAIを既存のワークフローに組み込んでいますが、AIからの出力を『信頼できるデータ』として無条件に受け入れていないでしょうか。今回の件は、AIの出力もまた、インターネットからの未知の入力と同様に、厳格に監視(エグレス・フィルタリング)すべき対象であることを教えてくれています」(同)

ビジネスの現場において、AIの利用を禁止するのは現実的ではない。今回の件を踏まえ、企業は以下の対策を講じるべきだ。

エグレス(送信)通信の監視と制限:エンタープライズ環境からAIサービスへの通信だけでなく、AIが稼働する実行環境からの外部通信(特にDNSリクエストや非正規ポートの通信)をホワイトリスト形式で制限する。

間接的プロンプト注入(Indirect Prompt Injection)への理解:外部のWebサイトやドキュメントを要約させる際、そこに「隠された命令」が含まれている可能性を常に考慮する。従業員教育において、「AIに読み込ませる情報の信頼性」を評価するプロセスを組み込むことが肝要だ。

シャドーAIの排除:個人アカウントのChatGPT利用ではなく、API利用やエンタープライズ版(ChatGPT Enterprise等)を導入し、データがモデルの学習に使われないだけでなく、管理者がログや通信を完全にコントロールできる体制を整える。

煽られず、しかし「設計の転換」を

「ChatGPTに脆弱性」という言葉に、過度に怯える必要はない。しかし、AIが社会インフラ化するなかで、「セキュリティの重心が、システムの脆弱性から『モデルの振る舞い』へとシフトした」という事実は重く受け止めるべきだ。

今回の報道は、AIを「魔法の杖」ではなく、一つの「複雑なソフトウェア・スタック」として冷静に評価し、多層的な防御を構築するための重要な警鐘といえる。正しく怖がり、正しく備える。それが、LLM時代を生き抜く企業のスタンダードとなるだろう。

(文=BUSINESS JOURNAL編集部、協力=新實傑/サイバーセキュリティコンサルタント)