AI搭載型スマートグラス、一日中装着する時代に?グーグルとメタの最新デバイスでみえた未来

●この記事のポイント

・グーグル、「Android XR」を利用し、「Gemini」を搭載するメガネ型デバイスの試作機を発表

・メタ、ARメガネの研究プロジェクト「Project Aria」の最新の研究用グラス「Aria Gen 2」の詳細を発表

・メタのデバイスは研究開発用、グーグルのデバイスは一般向け製品のリリースを前提

大手テック企業2社のAI搭載スマートグラス(メガネ型デバイス)の最新デバイスの情報が出揃った。米グーグルは5月20日、スマートグラスの開発プラットフォーム「Android XR」を利用し、生成AI「Gemini」を搭載するメガネ型デバイスの試作機を発表。6月4日には米メタが、ARメガネの研究プロジェクト「Project Aria」の最新の研究用グラス「Aria Gen 2」の詳細を発表した。それぞれの注目すべき特徴や違いは何であるのか。また、どのような用途や利用メリット、活用法が想定されるのか。専門家の見解を交えて追ってみたい。

●目次

異なる言語を話す人同士の会話も可能に

グーグルは2012年にスマートグラス「Google Glass」を発表し(2023年に販売中止)、普及には至らなかったが、昨年にはXR(仮想現実・拡張現実)デバイスの開発プラットフォームである「Android XR」を発表し、同領域に注力していく姿勢をみせていた。すでにサムスン電子と開発したヘッドセット型の「Project Moohan」を発表していたが、5月には新たにより軽量のスマートグラス型の試作機を発表。カメラ、マイク、スピーカーを内蔵し、Geminiと連携。スマートフォンのアプリを利用でき、レンズ内のディスプレイに必要な情報が表示される。「スマートグラスはあなたが見たり聞いたりしているものを理解し、状況を把握し、重要な情報を記憶して、一日を通してサポートを提供」(公式サイトより)するという。メッセージ送信、Googleマップと連動したナビゲーション、写真撮影といった機能があり、自動翻訳機能を使えば異なる言語を話す人同士の会話も可能になる。

一方、これまで「Meta Quest 3」や「Ray-Ban Meta」を販売していたメタは前述の「Project Aria」を推進しており、2020年に「Aria Gen 1」を公開。今年6月にはその後継デバイスにあたる「Aria Gen 2」の詳細を公開した。コンピュータービジョン、機械学習、センサー技術の最新技術を融合したウェアラブルデバイスであり、 Gen 1から快適性とフィット感が向上。高度なカメラベースの視線追跡システムを搭載し、片目あたりの視線、輻輳(ふくそう)点、瞬き検出、瞳孔中心推定、瞳孔径、角膜中心など豊富な情報を提供し、装着者の視覚的な注意と意図をより深く理解。人間とコンピューターのインタラクションの新たな可能性が開かれるという。また、視覚慣性オドメトリ(VIO)を用いて空間座標系内でメガネを追跡でき、シームレスなナビゲーションとマッピングが可能になっている。

2つの大きな違い

主な特徴や注目すべき特徴について、ITジャーナリストの酒井麻里子氏は次のように解説する。

「メタ『Aria Gen 2』は、あくまでも研究開発用のデバイスで、これ自体が製品化されるわけではありません。グラス型のデバイスに複数のカメラや視線追跡機能、手の動きを検知する3Dハンドトラッキング、心拍センサーなどが搭載され、装着者自身やその周囲の環境を検知してデータを集めることができるようになっています。加えて、デバイス内で処理が完結する(オンデバイス)AIも搭載され、収集したデータを扱えるようになっています。研究者がこのデバイスを使ってデータを集め、AIをトレーニングすることが主な目的です。

グーグルの『Project Aura』は次世代ARデバイスの製品化に向けたプロジェクトで、ARデバイスメーカーのXreal、デバイスに搭載するチップを開発するクアルコムとの協業で進められています。具体的な製品の発売時期は未公表ですが、5月のGoogleI/Oでは試作機を使ったデモとして、グーグルのAI『Gemini』を使ったリアルタイム翻訳や道案内の様子が披露されています」

2つの大きな違いは何か。

「メタのAria Gen 2は『研究者のデータ収集用』、グーグルのProject Auraは『一般向け製品のリリースを前提としたプロジェクト』という違いがあります。レストランで新メニューを開発する場合にたとえるなら、Aria Gen 2は『シェフが厨房で試行錯誤している』段階、Project Auraは『メニューの方向性が固まり、常連客向けに試食会を実施している』段階というイメージです。どちらのメニューもまだ、一般客が注文して食べることはできません。

グーグルのProject Auraは、この先のロードマップがある程度明らかになっています。まず、6月11日には、米国で開催されているXRカンファレンス『Augmented World Expo』のなかで、より詳細な情報が発表されました。そして、今年後半には開発者向けツールの提供を開始するとされています。製品の発売時期は公式には発表されていませんが、早ければ2026年には登場するのではと噂されています。

一方のメタは、具体的なロードマップを公表していません。とはいえ、将来的にAria Gen 2で得られた知見をベースにした製品がリリースされる可能性は高いと思われます。その際には、2社のグラスは似たような機能を備えた競合製品になるかもしれません」(酒井氏)

グラス型デバイス、機能や用途で大別

では、どのような用途や利用メリット、活用法が想定されるのか。

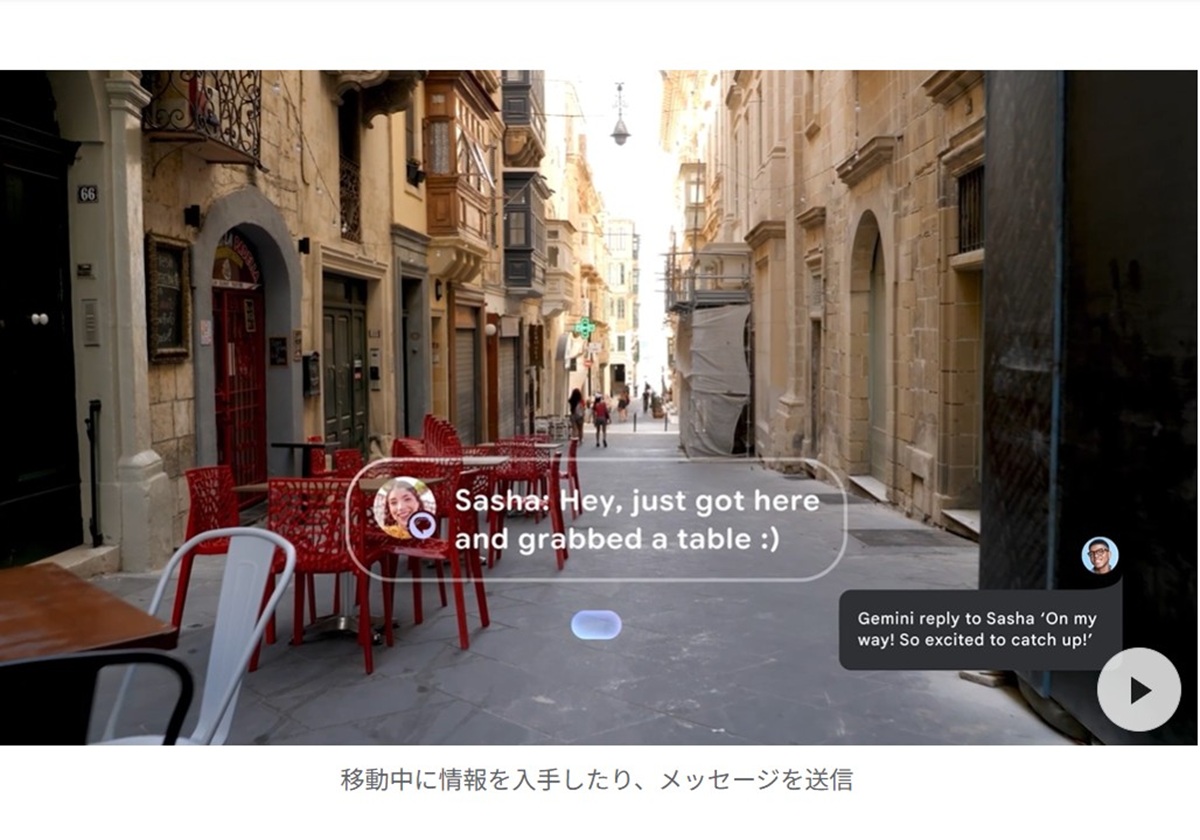

「Project Auraのデバイスは、1日中かけたまま使うことを想定して設計されています。つまり、『今までスマホを操作してやっていたことを、スマホと接続したグラスからハンズフリーで行えるようになる』というイメージです。Google I/Oのデモでは、目の前の人が話す言葉をリアルタイムで翻訳してグラスに表示したり、グラス越しにナビを表示したり、グラスを使ってメッセージに返信したりといった操作をする様子が披露されました。スマホをポケットから出して画面を見ながら操作しなくても、グラスとAIの音声操作を使って、さまざまな操作ができるようになると期待されています。

『グラス型のデバイス』には、すでに一般販売されている製品もありますが、同じような形状でも、機能や用途でいくつかに大別できます。

(1)次世代型:Project Auraで予告されているサングラス型のデバイスや、Meta Ariaで集めた技術をベースに将来開発される可能性のあるメタのデバイス。常時装着してスマホのように使用(未発売)。

(2)仮想ディスプレイ型:PCやスマホの画面を映し出すデバイス。大画面の外部ディスプレイとして使用(XREAL Oneなど)

(3)現場支援型:ヘルメットなどに装着して、現場作業の補助に使われるデバイス。搭載されたカメラで装着者が見ている映像を遠隔にいる人に共有したり、ディスプレイに作業指示を表示したりできる。

(4)その他:オーディオ再生に特化したもの(Bose Framesなど)や、心拍センサーなどを備えたスポーツ向けのデバイス(ENGO 2など)など。

なかでも違いが分かりづらいのは、仮想ディスプレイ型(現行のXREAL製品など)と、これから登場する次世代型かもしれません。大きな違いは、仮想ディスプレイ型が『必要なときだけ装着して、特定の用途だけに使用する』ものであるのに対して、次世代型は『1日中装着する前提の汎用型』になる点です。私もXREALの歴代モデルを使っています。画質や使い勝手は年々向上していると感じる一方で、長時間使っていると目が疲れてくるので、長くても数時間が限度だなと感じています。そして、サングラスに近い外観でかなり威圧感があるので、どこでも使えるとはいいがたいです……笑」(酒井氏)

(文=BUSINESS JOURNAL編集部、協力=酒井麻里子/ITジャーナリスト、ライター)